comfyui如何学习?如何使用?

最近在Linux的部署了ComfyUI,遇到一些小坑来记录下。

如果你遇到报错是:<>AttriuteError:'NoneType'ojecthasnoattriute'tokenize',建议看看这个文章。

<>另外,如果你找不到TripleCLIPLoader,也可以看看这个文章!!

ComfyUI是一个开源的、基于节点的图形用户界面(GUI),用于生成图像。它利用诸如StaleDiffusion等扩散模型,允许用户通过连接不同功能的节点来构建图像生成的工作流程。每个节点代表一个特定的功能模块,如加载模型、输入提示词、设置采样器等。所以相当于,他把模型整个调用的过程可视化了一下,只要修改图上的节点就行,如果你体验过一些机器学习深度学习的,那你肯定也熟悉这种作方式。

首ComfyUI的Githu链接:

如果你也是Linux的,windows也是一样,那咱们就继续往下看安装流程:

按照GitHu里描述的(下图)

<>第一步,你可以anaconda开一个新的python虚拟环境,python版本是3.12。

<>第二步,Gitclone这个项目

<>第三步,将模型文件ckpt或safetensor放到models/checkpoints文件夹

stailityai在huggingface上给出了最新的stalediffusion3.5模型,你需要先提供自己的信息,得到获取模型的许可申请,然后去Filesandversions栏目下,找到你的模型:

然后下载这个sd3.5_large.safetensors

<>第四步,VAE的文件放到models/vae文件夹

VAE的文件在:

下载了这俩文件直接放文件夹就行。

<>这四步都整完以后,如果你是NVIDIA的GPU如4090啦,A100啦,你就继续下面这两步pipinstall,如果是AMD的GPU人家也有写命令行,看网页吧。

pipinstalltorchtorchvisiontorchaudio--extra-index-ls://download.pytorch.org/whl/cu124

pipinstall--pretorchtorchvisiontorchaudio--index-ls://download.pytorch.org/whl/nightly/cu124

<>GitHu页面上的最后一步就是安装requirements了。

pipinstall-rrequirements.txt

按照道理来说,接下来你就可以起了。

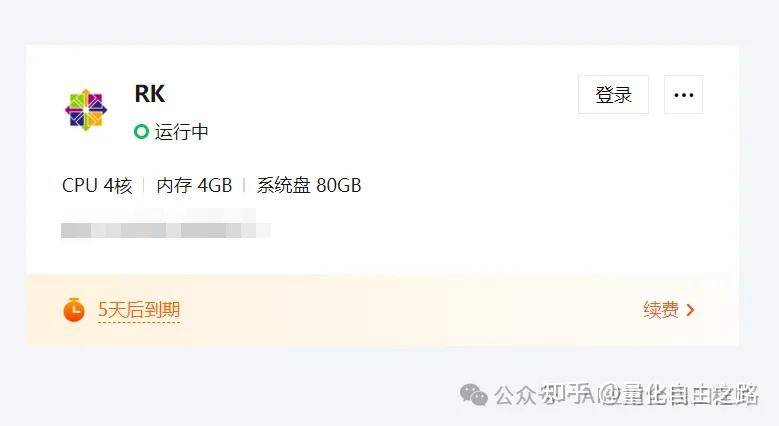

然后这里如果想把网页暴露在某个端口,你要上网搜搜怎么弄,我是在租的平台上设置一下

然后pythonmain.py---portXXXX,就行了。

<>结果!!这里报错了,说我:AttriuteError:'NoneType'ojecthasnoattriute'tokenize'

然后开始找怎么弄,也没看到主页写clip啥的呀,在issue里看到一个帖子:

这个帖子里有个大哥po了另一个帖子:

果然在里面找到了三个clipXXX.safetensors的链接,如果你没办法直接下载,那是因为你没申请许可。

Clip文件在:

在StaleDiffusion模型中,CLIP文件起着至关重要的作用,主要用于文本与图像的关联和对齐。CLIP(ContrastiveLanguage–ImagePre-training)是由OpenAI开发的一种多模态模型,能够将文本和图像映射到同一个潜在空间中。它使用对学习的方法,使得描述同一事物的文本和图像在潜在空间中的距离更近,而无关的文本和图像距离更远。在StaleDiffusion模型中,CLIP的主要功能是:用户输入的文本(如提示词)会通过CLIP模型中的文本编码器进行编码,生成textemeddings。这些emeddings捕捉了文本的语义信息,便于模型理解用户的输入。接着,这些emedding会作为生成模型的条件输入。生成模型根据这些嵌入来引导其生成符合文本描述的图像。

怪不得是clip.tokenize(text)函数,原来在做textemedding呢。突然觉得有意思了,有没有。

好的,如果这个时候你下载好了clip文件,记得把他们放在models/clip文件夹下!

然后,你就可以重新开起server。

<>这个时候可能你还是报错。。。

然后你,就要看看这个帖子:

原来是我的clip文件并没有很好的加载!!!我搜了好几个,都提到一个TripleCLIPLoader的东西,然后我看到下图里有这个从NodeTemplates点击进去到这个TripleCLIPLoader的方式,我就开始探索。

结果我发现我的NodeTemplates下面只有一个Manage,不好意思第一次玩ComfyUI,我着实不熟悉:

然后我就去探索了一下,ComfyUI的边栏,我,被我发现了NodeLirary!!!虽然没有直接找到,但是你可以搜到这个TripleCLIPLoader。

添加了以后,你就把三个clip文件改一下,然后node和node之间的线连接一下。如果你不会,你就应用一下你从小培养的电子产品第六感试试。连接的方式:

然后你就可以运行了,点击Queue。

然后你就发现有一个任务正在运行

然后就画出来啦!!

<>最后的最后,祝你成功!!!